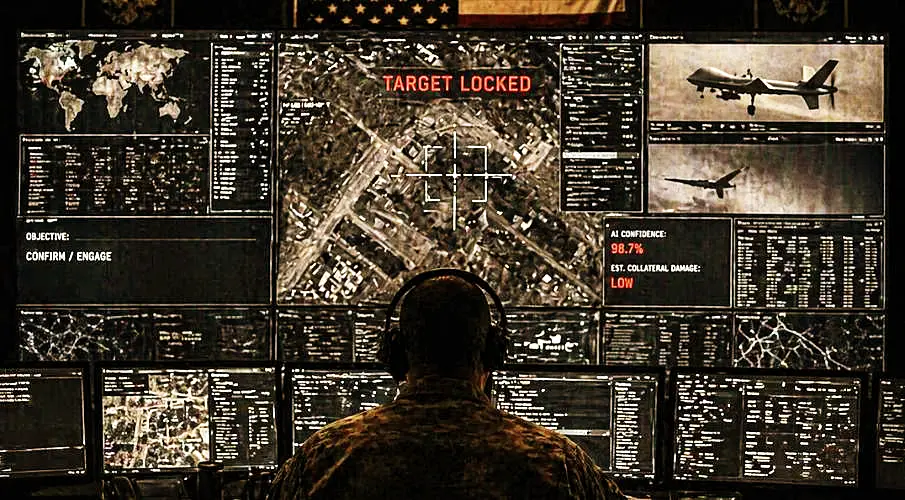

Im Haushaltsantrag über 1,5 Billionen Dollar taucht ein Begriff auf, der harmlos klingt und doch nach Recherchen alles verändert: Special Operations Autonomous Warfare Center. Ein Zentrum, das genau dafür gebaut wird, was lange vorbereitet wurde. Daten sammeln, Ziele auswählen, Angriffe auslösen. Der Ablauf steht, nur der Mensch steht noch dazwischen. Seit Jahren verarbeitet das US-Militär gewaltige Mengen an Informationen. Satellitenbilder, Kommunikationsdaten, Bewegungsprofile. Was früher Tage dauerte, passiert heute in Minuten. Programme ziehen Verbindungen, markieren Orte, setzen Prioritäten. Am Ende steht ein Punkt auf einer Karte. Ein Ziel. Was jetzt kommt, entscheidet über Leben und Tod.

Die Einheiten, die damit arbeiten, sind nicht neu. Navy SEALs, Green Berets, Delta Force. Spezialeinheiten, die seit den Anschlägen vom 11. September gezielte Tötungen zu einem zentralen Instrument gemacht haben. Festnehmen, ausschalten, Strukturen zerschlagen. Diese Logik hat sich über zwei Jahrzehnte aufgebaut. Jetzt wird sie beschleunigt.

Im Haushalt taucht es unscheinbar auf, fast versteckt zwischen Zahlenkolonnen und Standardformulierungen. Doch genau dort steht, was den eigentlichen Bruch markiert. Das US Special Operations Command fordert zusätzliche Mittel, um die Schlagkraft seiner Einheiten auszubauen – mehr Präsenz, mehr Projektion, mehr Zugriff. Dahinter steckt nicht nur klassische Aufrüstung, sondern der nächste Schritt. Der Antrag nennt ausdrücklich den Aufbau eines „Special Operations Forces Autonomous Warfare Center“. Ein Zentrum, das die bestehenden Strukturen nicht ersetzt, sondern verdichtet. Aufklärung, Auswertung, Zielauswahl – alles wird enger zusammengezogen, schneller gemacht, direkter verbunden.

Die Begründung folgt der bekannten Linie. Wachsende Bedrohungen, globale Einsätze, steigender Druck auf Spezialeinheiten. Gleichzeitig wird deutlich, wohin sich das System verschiebt. Nicht mehr nur Unterstützung für Operationen, sondern die Automatisierung genau dieser Abläufe. Auffällig ist, was nebenbei passiert. Während neue Fähigkeiten aufgebaut werden, verschwindet an anderer Stelle Raum. Programme zur Bewertung ziviler Schäden tauchen im Antrag nicht mehr auf. Der Teil, der prüfen und bremsen könnte, wird nicht weitergeführt. So steht es schwarz auf weiß in einem Dokument, das kaum jemand liest. Mehr Mittel für Spezialeinheiten. Ein neues Zentrum für autonome Kriegsführung. Und weniger Kontrolle über die Folgen.

Das neue Zentrum verändert nicht die Methode, sondern die Geschwindigkeit. Die Infrastruktur existiert längst. Aufklärung, Zielerfassung, Angriff. Was fehlt, ist nur noch Zeit. Genau diese Zeit wird entfernt. Die Programme übernehmen den Teil, der bisher überprüft wurde. Der Schritt vom Verdacht zur Entscheidung wird kürzer. Offiziell bleibt der Mensch im Prozess. Admiral Brad Cooper sagt, Menschen würden immer entscheiden, was angegriffen wird und was nicht. Doch genau hier liegt der Widerspruch. Wenn Systeme in Sekunden auswerten, vergleichen und markieren, wird jede Verzögerung zum Problem. Der Mensch wird zum Engpass. Und ein Engpass wird in militärischen Abläufen nicht dauerhaft akzeptiert.

Die Erfahrung mit Drohnen zeigt, wohin das führt. Anfangs hieß es auch dort, jeder Einsatz werde sorgfältig geprüft. Mit der Zeit wurde die Kette verdichtet. Entscheidungen wurden schneller, Abläufe routinierter. Am Ende blieb oft nur noch ein Bestätigen. Ein Klick, der den Prozess abschließt, nicht mehr hinterfragt.

Auf den ersten Blick ist es nur eine kleine Tabelle. Doch mitten zwischen Verwaltung, Suizidprävention und Programmen gegen sexuelle Gewalt verschwindet ausgerechnet der Posten, der zivile Schäden erfassen und begrenzen soll. Maßnahmen zur Begrenzung ziviler Schäden und Reaktionen darauf stehen im Vorjahr noch mit 259 drin. Danach nichts mehr. Kein Ausbau, keine Fortführung, nicht einmal ein Restbetrag. Das ist kein technischer Vorgang und keine beiläufige Kürzung. Gestrichen wird genau der Bereich, der überhaupt noch festhält, was militärische Gewalt bei Zivilisten anrichtet. Alles andere läuft weiter. Dieser Teil nicht.

Parallel dazu verschiebt sich etwas anderes. Im gleichen Haushalt verschwindet die Finanzierung für Programme, die zivile Schäden erfassen und begrenzen sollen. Ausgerechnet der Teil, der warnen könnte, wird gestrichen. Die Systeme werden schneller, die Korrektive weniger. Die militärische Logik dahinter ist klar. Gegner setzen auf Masse. Drohnen, einfache Raketen, billige Systeme in großer Zahl. Darauf antwortet man mit Automatisierung. Mehr Ziele, mehr Geschwindigkeit, mehr Reaktionen in kürzerer Zeit. In der Ukraine und im Krieg mit Iran wurde genau das sichtbar. Die Herausforderung ist nicht mehr ein einzelnes Ziel, sondern viele gleichzeitig.

Auch andere Kommandos arbeiten bereits in diese Richtung. Das Southern Command in Miami automatisiert die Verfolgung von Drogenrouten, bei denen Schnellboote und Mini-U-Boote als Ziele gelten. Der Schritt von der Verfolgung zur Bekämpfung ist technisch klein. Auffällig ist, wie wenig darüber gesprochen wird. Im Kongress gibt es bisher keine ernsthafte Debatte über solche Strukturen. Der Posten steht im Budget, eingebettet in Sonderprogramme, weitgehend abgeschirmt. Entscheidungen fallen, ohne dass öffentlich klar wird, was sie bedeuten.

General Stanley McChrystal beschreibt die Entwicklung offen. Er vergleicht die Technik mit einem Kind, das schon früh töten kann und mit der Zeit immer stärker wird. Was er nicht sagt, ist, dass Stärke allein keine Richtung vorgibt. Systeme treffen keine moralischen Entscheidungen. Sie setzen um, was ihnen vorgegeben wird. Die entscheidende Frage bleibt damit einfach und unbequem. Wenn die Maschine schneller entscheidet als der Mensch, wer kontrolliert am Ende den Ablauf. Und wie lange bleibt der Mensch tatsächlich Teil dieser Entscheidung.

Fortsetzung folgt …

Updates – Kaizen Kurznachrichten

Alle aktuellen ausgesuchten Tagesmeldungen findet ihr in den Kaizen Kurznachrichten.

Zu den Kaizen Kurznachrichten In English